Midjourney, DALL-E, DeepAI – janë programe, të cilat krijojnë foto mjaft realiste me ndihmën e inteligjencës artificiale. Pamje që kanë vërshuar në mediat sociale. Si mund të dallohen pamjet e vërteta nga mashtrimet?

Asnjëherë nuk ka qenë kaq e thjeshtë të krijosh pamje gati, gati realiste. Një lidhje interneti mjafton dhe një program që punon me inteligjencën artificiale, e brenda sekondash krijohen pamje aq realiste, sa shumë prej nesh mund të gënjeheshin. Foto të tilla po përhapen shpejt në mediat sociale dhe shpesh përdoren me qëllim për disinformim. Disa pamje të fundit virale: Putini që gjoja po e arrestojnë. Donald Trump që po ashtu sikur është në arrestim e sipër. Elon Musk duke mbajtur duart me Mary Baran, CEO të General Motors. Pamje tregojnë ngjarje që nuk kanë ndodhur kurrë.

Tërmete që nuk kanë ndodhur

Nëse gjoja ndjekja spektakolare apo arrestimi i Putinit e Trumpit mund të verifikohen shpejt, duke parë edhe mediat serioze, ka pamje të tjera problematike, ku njerëzit nuk janë persona të njohur, thotë eksperti i inteligjencës artificiale, Henry Ajder për DW. “Dhe jo vetëm fotot e krijuara me pamje njerëzisht mund të shpërndajnë keqinformimin.” Kemi parë trillime ngjarjesh që nuk kanë ndodhur kurrë, si për shembull tërmete”, thotë Ajder, “si p.sh. rasti i një tërmeti të rëndë që paska tronditur Paqësorin në vitin 2022. Por ky tërmet nuk ka ndodhur kurrë, pamjet për këtë janë krijuar artificialisht dhe janë shpërndarë në Reddit.”

Para këtyre fotove është shumë e vështirë të dallosh të vërtetën nga pamja e trilluar. Por ashtu si gabimi është njerëzor edhe inteligjenca artificiale gabon. Ende. Sepse programet e inteligjencës artificiale po zhvillohen me shpejtësi. Deri në prill 2023 programe si Midjourney, Dall-E und DeepAI kanë kryesisht pamje me njerëz, që kanë problemet e tyre në paraqitjen e IA. Ja disa mënyra si të dallosh manipulimet.

- Zoom- zmadho dhe shiko me kujdes

Shumë pamje të inteligjencës artificiale duken si të vërteta dhe vetëm duke i afruar mund të dallosh se ato janë “fake”. Prandaj shikoni me vëmendje, kërkoni versione me cilësi të lartë dhe bëni “zoom”- pra afroni foton që të dalloni detajet. Në zmadhim mund të dallosh gabime, mospërputhje, apo klonim të fotos – gjëra që mbeten të pazbuluara në shikim të parë.

- Kërkoni origjinën e fotos

Nëse jeni të pasigurtë nëse është foto e vërtetë apo e krijuar artificialisht kërkoni më shumë për origjinën e saj. Nganjëherë përdoruesit në komentet e tyre shkruajnë informacionet që kanë, që mund të ndihmojnë të shkosh deri në burimin e saj apo në postimin e parë të fotos. Këtu mund të ndihmojë një kërkim pas: Foto kalohet në programe si ai i kërkimit të Google, TinEye apo Yandex, që jo rrallë ofrojnë informacione për pamjen dhe nganjëherë të çojnë në origjinën e saj. Nëse në kërkim dalin rezultate që lidhen me kontrollin e fakteve për këtë pamje nga media serioze, atëherë ato si rregull ofrojnë informacione sqaruese.

- Vëreni proporcionet e trupit

Janë në rregull proporcionet e personave të paraqitur? Jo rrallë pamjet e inteligjencës artificiale tregojnë mospërshtatje të proporcioneve; duart shumë të vogla, apo një gisht shumë më i gjatë. Koka dhe këmbët nuk përshtaten me pjesën tjetër të trupit. Si për shembull pamje virale, ku Putini gjunjëzohet para Xi Jinpingut. Këpuca e pasme që duhet të jetë e Putinit është joproporcionalisht e madhe dhe e gjerë, pulpa shumë e zgjatur. Koka gjysmë e fshehur e personit është shumë e madhe e nuk përshtatet me trupin.

- Vëreni gabimet tipike të inteligjencës artificiale

Gabimet kryesore të programeve të inteligjencës artificiale si Midjourney apo DALL-E janë tek duart. Shpesh personat kanë një gisht të gjashtë, si polici majtas Putinit(shiko foton) Apo ku Papa Françesku pozon me xhaketë marke. Pamjet u bënë virale megjithëse Papa në pamjen e djathtë ka vetëm katër gishta dhe djathtas gishtat janë shumë të gjatë. Gabime të tjera të programeve vërehen tek dhëmbët, ku personat kanë shumë dhëmbë, apo syze të deformuara, veshë me forma jo reale. Edhe sipërfaqet reflektuese i krijojnë probleme inteligjencës artificiale.

Eksperti, Henry Ajder paralajmërron: “Në variantin aktual të Midjourney ka ende gabime si fotoja e Papës, por ai është shumë më i saktë në krijimin e duarve si variante të mëparshme. Drejtimi dihet: Ne nuk mund të bazohemi më gjatë tek ajo që këto programe bëjnë edhe gabime të tilla.”

- A duket pamja shumë artificiale dhe shumë ideale?

Aplikacioni Midjourney krijon pamje që janë shumë të bukura për të qenë të vërtetra. Shikoni me vëmendje – a mund të jetë pamja e një njeriu real kaq estetikisht e saktë ? Andreas Dengel, drejtues i Qendrës Gjermane për Studimet e Inteligjencës Artificiale, thotë se “pamjet shumë të pastra. Edhe tekstilet e treguara janë shumë harmonike.” Po ashtu edhe lëkura e personave është tejet e lëmuar, dhëmbët apo flokët duken aq bukur sa të kuptohen si jorealiste. Programet zhvillojnë shpesh pamje të idealizuara të njeriut që t’u pëlqejnë njerëzve. Kjo është pikërisht dobësia e tyre dhe kështu mund të dallosh edhe pamjet e falsifikuara.

- Kontrolloni sfondin e fotos

Nganjëherë edhe sfondi tradhton. Edhe në sfond mund të dallosh manipulimet, si për shembull dritat e rrugës. Shpesh ai është i paraqitur jo i pastër e duket i sfumuar. Por edhe tek sfumimi mund të dallosh gabime, si tek pamja e Will Smith që gjoja e tregon atë të zemëruar në dhënien e Oscar. Edhe kjo pamje është fake.

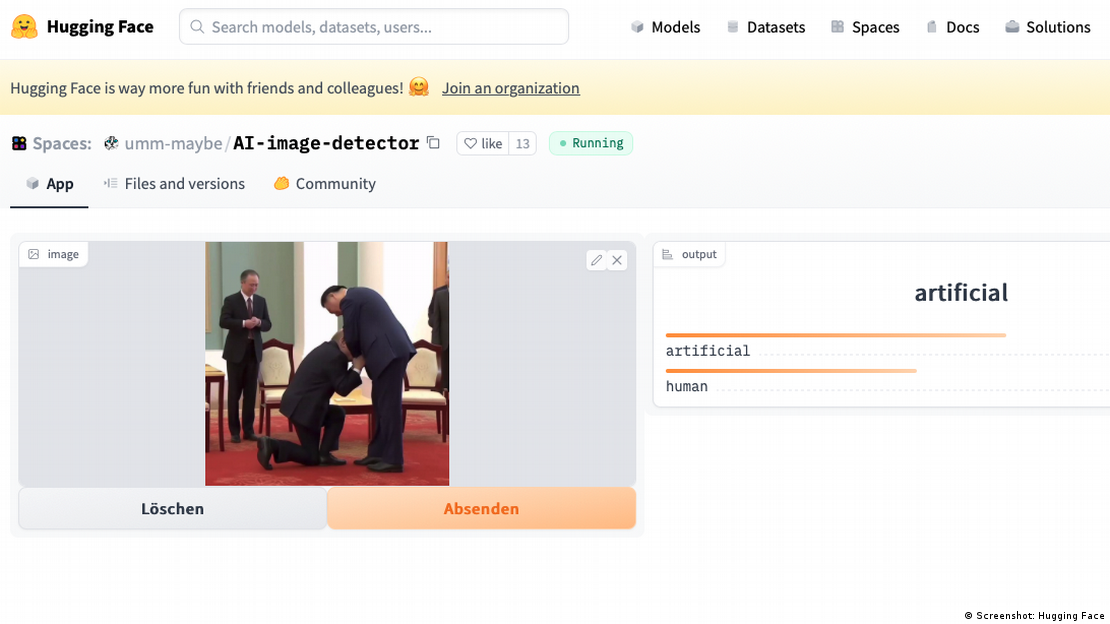

Shumë foto të inteligjencës artificiale me pak hulumtim mund të zbulohen se janë manipulime. Por teknologjia në të ardhmen do të përmirësohet dhe dallimi i gabimeve do të bëhet më i vështirë. Programe detektorësh si Hugging Face mund të ndihmojnë të japin të dhëna, por jo më shumë. Problemi i tyre; ato bëjnë gabime. Nganjëherë edhe fotot realiste shpallen fake, dhe ekspertët nuk e këshillojnë përdorimin e tyre, sepse përgjigjet që japin këta dedektorë nuk janë të besueshme plotësisht. Antonio Krüger nga Universiteti i Saarit, Gjermani flet për një “garë teknologjike” me inteligjencën artificiale. “Besoj se ne duhet të mësohemi tani me atë që asnjë pamjeje në internet nuk mund t’i besohet plotësisht”, raporton DW.